Post by doinGlobal | 31 March, 2026 | ai academy All Law Volver al blog

Legal prompting: por qué la calidad jurídica de la IA depende de cómo se le instruye

La inteligencia artificial generativa ya opera en los flujos de trabajo de estudios jurídicos, áreas legales corporativas y organismos públicos de toda la región. No como un agregado innovador, sino como herramienta cotidiana que redacta borradores, resume expedientes y asiste en la elaboración de dictámenes. Esta incorporación no ha sido el resultado de una decisión estratégica colectiva: ocurrió de manera gradual, impulsada por la presión de la productividad y la accesibilidad de las herramientas.

El problema no es ese acceso. El acceso está democratizado. El problema es lo que sucede cuando una tecnología de alta capacidad aparente se utiliza sin el andamiaje conceptual que la práctica jurídica exige. Y ese andamiaje tiene un nombre preciso: legal prompting.

¿Qué es el legal prompting y por qué no es lo mismo que “usar IA”?

Los modelos de lenguaje de gran escala (LLM) no recuperan información como lo hace un buscador: operan prediciendo la continuación estadísticamente más probable de una secuencia de texto. Esto implica que el resultado generado no depende únicamente de lo que el modelo “sabe”, sino de cómo se le formula la instrucción. En el ámbito jurídico, esa distinción es crítica.

El legal prompting —o ingeniería de instrucciones jurídicas— es la competencia profesional que consiste en diseñar instrucciones claras, específicas y contextualizadas para que un sistema de IA genere resultados jurídicamente útiles, válidos y pertinentes. Se diferencia del prompting generalista en un punto fundamental: en el derecho, la ambigüedad no produce resultados mediocres. Produce riesgo.

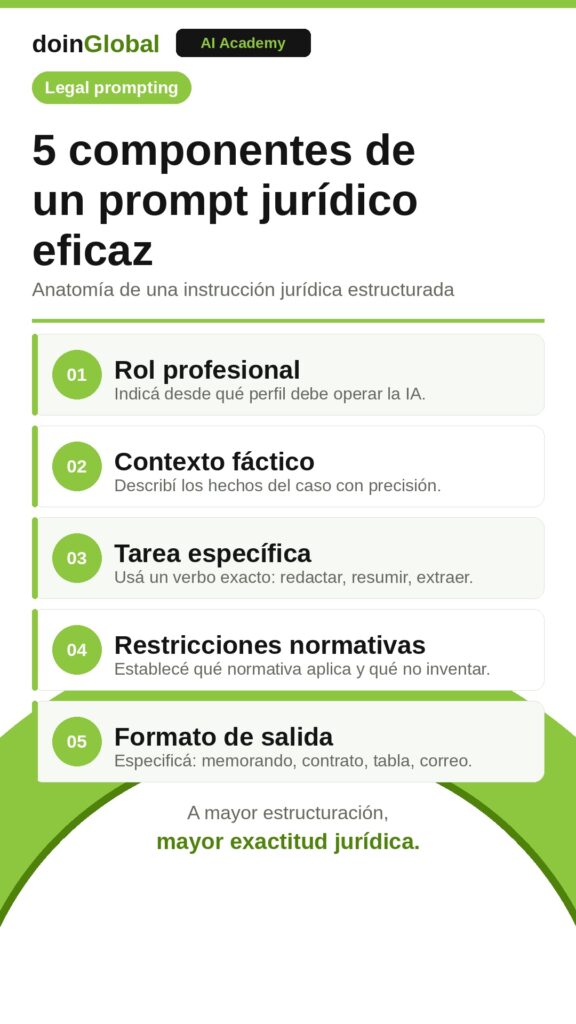

Una instrucción bien construida para el entorno jurídico requiere cinco componentes estructurales:

- Rol profesional: indicar a la IA desde qué posición debe operar (“actúa como especialista en derecho laboral”, “analiza como lo haría un tribunal de primera instancia”). Esta directriz orienta al modelo hacia terminología técnica y patrones de razonamiento específicos.

- Contexto fáctico: suministrar todos los antecedentes relevantes del caso. Los modelos carecen de acceso a la verdad fáctica; sin ese marco, rellenan los vacíos con suposiciones estadísticas.

- Tarea específica: definir con precisión la acción esperada. No es lo mismo “resumir” un fallo que “extraer sus argumentos centrales” o “redactar una cláusula de rescisión”. La especificidad previene respuestas divagantes.

- Restricciones normativas: establecer límites explícitos, tanto negativos (qué no debe hacer el modelo) como positivos (qué condiciones debe cumplir). En redacción legal, esto incluye, por ejemplo, instruir al sistema para que no invente citas bibliográficas o jurisprudenciales si no dispone de información verificable.

- Formato de salida: especificar la estructura del resultado esperado: memorando, tabla comparativa, contrato con cláusulas enumeradas, correo institucional. Definirlo a priori elimina el tiempo de edición posterior y asegura que el producto se ajuste a los estándares de presentación profesional.

La ausencia de cualquiera de estos componentes no genera simplemente un borrador imperfecto. Genera un borrador que parece correcto pero puede no serlo.

¿Qué riesgos concretos genera un prompt jurídico deficiente?

La diferencia entre una instrucción vaga y una instrucción estructurada no es de grado: es de naturaleza. Para ilustrarlo, consideremos una situación frecuente: la redacción de un contrato de locación.

Un prompt como “Redacta un contrato de alquiler” carece de todos los componentes analizados. Al no definir el rol, la IA utilizará un tono genérico. Al omitir el contexto y la jurisdicción, producirá con alta probabilidad un documento basado en legislación de arrendamiento española o anglosajona, con términos como landlord y cláusulas que pueden ser nulas en el ordenamiento jurídico local del profesional. El resultado será un texto que requiere revisión y reescritura total, anulando cualquier ganancia de eficiencia.

En cambio, una instrucción que especifique el rol, la jurisdicción aplicable, las partes, los plazos, los índices de ajuste y el formato esperado, produce un borrador técnicamente orientado, con terminología correcta del fuero local y estructura ajustada al caso. La diferencia no está en la herramienta: está en quien la instruye.

Este fenómeno tiene implicaciones que van más allá de la eficiencia operativa:

- Riesgo de alucinaciones normativas: los modelos pueden inventar precedentes o aplicar normativas derogadas cuando la instrucción no delimita el marco legal vigente. El texto resultante es plausible en su forma pero inválido en su contenido.

- Sesgo de jurisdicción: los LLM han sido entrenados con una sobrerrepresentación de contenido en inglés y de nociones propias del Common Law. Sin una referencia explícita al sistema jurídico aplicable —”conforme al Código Civil y Comercial de la Nación Argentina” o “bajo la normativa del RGPD de la UE”— el modelo tenderá por defecto a aplicar principios anglosajones o a mezclar conceptos de distintos ordenamientos, produciendo textos jurídicamente híbridos e inaplicables.

- Responsabilidad profesional no transferible: la firma de un documento jurídico asistido por IA no traslada la responsabilidad al modelo. El profesional que entrega ese documento responde por su contenido. Un borrador deficiente, aunque generado automáticamente, compromete la calidad del servicio y la reputación del profesional.

- Falta de trazabilidad: cuando no existe registro de las instrucciones utilizadas, las fuentes consultadas o las iteraciones realizadas, el proceso se vuelve indefendible ante auditorías internas o cuestionamientos judiciales.

La brecha no es tecnológica. Es metodológica. Y esa brecha tiene consecuencias reales.

Una certificación para desarrollar criterio, no solo habilidad técnica

La Certificación Profesional en Inteligencia Artificial Aplicada a la Redacción Jurídica, desarrollada por AI Academy by doinGlobal, parte de una premisa que distingue este programa de los cursos generales de IA para abogados: el problema central no es el acceso a herramientas, sino la ausencia de un método profesional para integrarlas.

El programa no enseña a usar IA. Enseña a integrarla con criterio en flujos de trabajo jurídicos reales, con estándares verificables y control profesional. Eso implica:

- Legal prompting estructurado por género jurídico: contratos, escritos judiciales, dictámenes. No prompts aislados, sino arquitectura metodológica reutilizable.

- Protocolos de verificación y citación responsable: herramientas para detectar errores normativos, validar fuentes y documentar el proceso de revisión.

- Trazabilidad real: registro de prompts, versiones, fuentes y decisiones adoptadas durante la redacción, que hace el proceso defendible ante terceros.

- Gobernanza y confidencialidad: criterios para clasificar información sensible, minimizar la exposición de datos y operar dentro de los límites éticos y deontológicos de la profesión.

- Taller aplicado: producción y auditoría de un documento jurídico completo —contrato, dictamen o escrito judicial— con apoyo de IA generativa, bajo supervisión profesional.

El programa tiene una duración de 31 horas, modalidad 100% asincrónica y flexible, con acceso disponible durante seis meses. Incluye una masterclass a cargo de Juan Gustavo Corvalán —director del Laboratorio de Innovación e Inteligencia Artificial de la Universidad de Buenos Aires y referente regional en IA aplicada al derecho— sobre control, seguridad y transparencia en la redacción jurídica con IA.

Está dirigido a abogados en ejercicio, equipos legales corporativos, estudios jurídicos, profesionales de compliance y consultores que buscan integrar la IA en su práctica con método y rigor. No requiere formación técnica ni conocimientos de programación.

El criterio profesional no se delega

La inteligencia artificial generativa amplía la capacidad productiva del profesional jurídico. Pero esa ampliación es proporcional a la calidad de las instrucciones que la orientan. Un modelo de lenguaje entrenado con millones de documentos legales no sustituye el juicio del abogado: requiere de ese juicio para producir resultados que tengan valor jurídico real.

El legal prompting es, en ese sentido, la expresión técnica de una exigencia que siempre estuvo en el centro de la práctica jurídica: la precisión en la formulación determina la validez del resultado. Trasladar esa exigencia al nuevo entorno de trabajo no es una opción. Es una responsabilidad profesional.

Quienes comprendan eso primero —y desarrollen la competencia para actuar en consecuencia— estarán mejor posicionados para liderar la transformación de sus equipos, sus estudios y sus organizaciones.

Conocé la Certificación Profesional en Inteligencia Artificial Aplicada a la Redacción Jurídica

Este artículo fue elaborado a partir del contenido del Módulo: “Diseño de prompts jurídicos y estilo profesional”, perteneciente a la Certificación Profesional en Inteligencia Artificial Aplicada a la Redacción Jurídica (AI Academy by doinGlobal). El material académico fue producido por el equipo docente del programa y refleja los fundamentos conceptuales que integran su currícula.

Notas Relacionadas

IA en la gestión tributaria: criterio jurídico y control para un nuevo estándar profesional

La IA en la gestión tributaria ya redefine cumplimiento, fiscalización y análisis. Comprende sus oportunidades, riesgos y exigencias profesionales.

Análisis predictivo y diagnóstico clínico asistido por IA: criterio clínico y gobernanza para decidir mejor en salud

El análisis predictivo y diagnóstico clínico asistido por IA ya influye en decisiones médicas. Aprende a evaluarlo, validarlo e implementarlo con criterio.

BIM en el ciclo de vida de proyectos: cómo gestionar información estratégica más allá del modelado

Descubre cómo implementar BIM en el ciclo de vida de proyectos mejora coordinación, costos y decisiones estratégicas en AEC/EPC.